Baca berita dengan sedikit iklan, klik disini

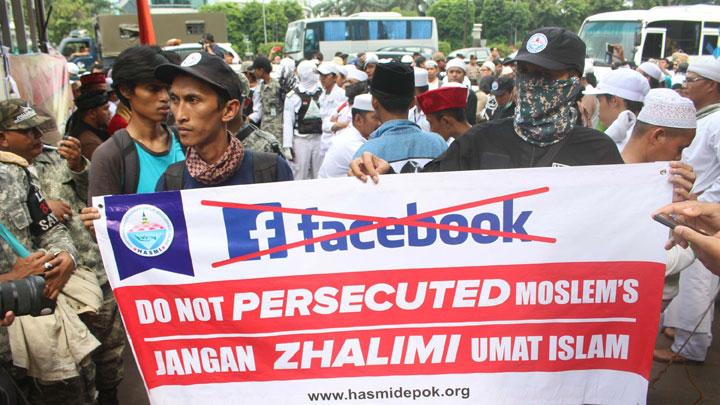

TEMPO.CO, Jakarta - Media sosial Facebook mengungkap caranya menangkal ujaran kebencian menyebar di platformnya. Mereka memiliki tim konten yang mengembangkan kebijakan-kebijakan berdasarkan masukan dari para ahli independen di bidangnya.

Baca berita dengan sedikit iklan, klik disini

"Seperti masukan dari ahli bidang teknologi, keselamatan publik, dan hak asasi manusia," kata Content Policy Manager, Hate Speech, di Facebook, Manu Gummi, dalam acara virtual bertajuk ‘Hate Speech Under the Hood’, Selasa 8 Juni 2021.

Baca berita dengan sedikit iklan, klik di sini

Baca berita dengan sedikit iklan, klik disini

Gummi menerangkan, tim kebijakan konten Facebook tersebar di 11 kantor di seluruh dunia. Mereka disebutkannya adalah bagian dari tim yang lebih besar dengan lebih dari 35 ribu orang yang bekerja dalam hal keselamatan dan keamanan di Facebook, termasuk lebih dari 15 ribu moderator konten.

Gummi menegaskan, standar komunitas Facebook adalah dokumen yang terus diperbaharui. “Artinya, kami terus mengembangkan kebijakan untuk bisa mengimbangi dan beradaptasi dengan perubahan perilaku di ranah online,” katanya.

Setiap dua minggu sekali, dia menambahkan, tim kebijakan konten itu mengadakan pertemuan yang disebut Policy Forum. Mereka akan berdiskusi tentang pembaruan dan penyesuaian standar komunitas dan kebijakan iklan.

"Hal ini penting, khususnya bagi kebijakan untuk ujaran kebencian, mengingat bahasa yang digunakan berkembang dengan cepat," kata Gummi sambil menambahkan, "Bahkan kata-kata yang biasa saja bisa digunakan sebagai cercaan berbahaya."

Facebook membawa para ahli dari berbagai perusahaan untuk berpartisipasi dalam Policy Forum. Dalam beberapa kesempatan, mereka membawa jurnalis dan akademisi ke dalam pertemuan ini untuk mengamati kegiatannya. Tim kebijakan konten berupaya tetap transparan terhadap pekerjaan mereka dalam dan sesudah Policy Forum.

Gummi juga memberi catatan bahwa tidak ada definisi yang disepakati secara global tentang apa itu ujaran kebencian. Negara-negara memiliki hukum terkait ujaran kebencian dengan definisinya yang sangat bervariasi.

Di Facebook, Gummi berujar, ujaran kebencian didefinisikan sebagai serangan langsung terhadap orang, berdasarkan karakteristik yang dilindungi. Definisi ini dikembangkan setelah melakukan riset eksternal yang mendalam dan konsultasi dengan ahli independen.

data

data

Lalu, apa yang dimaksud dengan serangan langsung? Facebook mendefinisikannya sebagai ujaran yang tidak manusiawi atau mengandung kekerasan, stereotip yang membahayakan pernyataan inferioritas, ekspresi penghinaan, ekspresi rasa jijik atau pengusiran, mengutuk, dan ajakan untuk pengucilan atau segregasi.

Sementara yang dimaksud dengan karakter yang dilindungi adalah ras, etnis, kewarganegaraan, disabilitas, agama, kasta, orientasi seksual, jenis kelamin, identitas gender, dan penyakit berat. Facebook juga menganggap usia sebagai karakteristik yang dilindungi saat dirujuk bersama dengan karakteristik lain yang dilindungi.

Media sosial besutan Mark Zuckerberg itu juga memberikan beberapa perlindungan untuk karakteristik seperti pekerjaan, ketika mereka direferensikan bersama dengan karakteristik yang dilindungi. “Facebook melindungi pengungsi, migran, imigran, dan pencari suaka dari serangan paling parah, meskipun kami mengizinkan komentar dan kritik terhadap kebijakan imigrasi,” kata Gummi.

![Siluet pengguna ponsel terlihat di samping layar proyeksi logo Facebook dalam ilustrasi gambar yang diambil 28 Maret 2018. [REUTERS / Dado Ruvic / Ilustrasi]](https://statik.tempo.co/data/2021/02/18/id_1001365/1001365_720.jpg)